Fake News

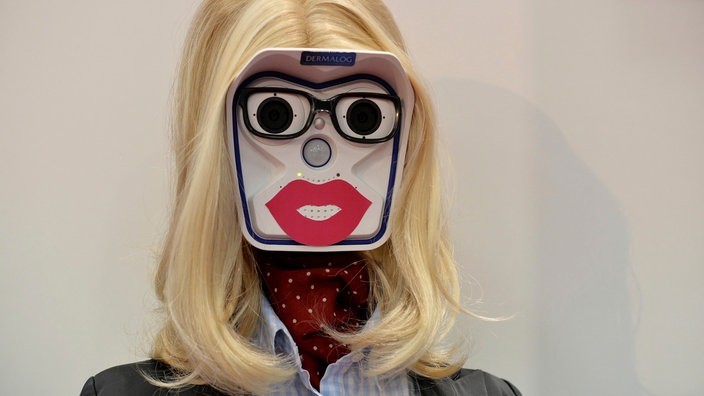

Wie gefährlich sind Bots?

Bots sind gezielt programmierte Roboter, die im Netz Meinungen äußern und Hass befeuern. Dabei ist für andere Nutzer nicht zu erkennen, dass es sich um Maschinen handelt und nicht um Menschen. Sogar die Politik können Bots beeinflussen, weil sie vor wichtigen Wahlen Stimmung bei Menschen machen.

Von Andrea Wieland

Was kann ein Bot?

Das Wort "Bot" ist eine Kurzform von "Roboter". Bots sind Computerprogramme, die in sozialen Medien wie echte Nutzer handeln und automatisch Botschaften verbreiten.

Gegenüber menschlichen Nutzern haben Bots zwei Vorteile: Sie können in Echtzeit auf aktuelle Debatten reagieren. Und theoretisch können unendlich viele von ihnen mit Social-Media-Konten verknüpft werden. Bots sollen Zustimmung oder Ablehnung simulieren und somit sogar Debatten und Stimmungsbilder manipulieren können.

Die Stimmungsmacher

Wie Bots Stimmungen beeinflussen, fand eine Studie der Uni Duisburg-Essen heraus. Das Team nutzte für sein Experiment die Erkenntnisse zur so genannten Schweigespirale: Aus der Forschung ist bekannt, dass Menschen sich weniger trauen, ihre Meinung zu vertreten, wenn sie damit in der Minderheit sind. Die Forscher untersuchten, wie Bots eine solche Spirale auslösen können.

Dabei fand das Team heraus, dass bereits eine geringe Anzahl von zwei bis vier Prozent Bots ausreicht, damit Nutzer in einer kontroversen Diskussion lieber still sind. Dadurch steige die Wahrscheinlichkeit, dass sich die von den Robotern unterstützte Meinung durchsetze, von 50 Prozent auf zwei Drittel.

Eine Gefahr für die Demokratie?

Manche Experten schätzen den Einfluss von Bots auf die politische Debattenkultur daher als hoch ein: Sie erwarten, dass Bots "das Internet und die demokratische Gesellschaft zersetzen" könnten. Außerdem sorgen sie offenbar dafür, dass die geäußerten Meinungen schnell extrem werden.

Das zeigte ein Experiment von Microsoft bereits im Jahr 2016. Ein Bot namens Tay sollte durch künstliche Intelligenz im Netz lernen, wie junge Menschen reden. Weniger als 24 Stunden später postete der Bot hauptsächlich sexistische und rassistische Kommentare.

Was Microsoft in seinem Experiment offensichtlich nicht bedacht hatte, war der Einfluss der kommunizierenden Nutzer, von denen Tay lernte. Es dauerte nicht lange, da wurde aus dem Tweet "Ich liebe alle Menschen" ein "Ich hasse alle". Schließlich postete sie gar: "Hitler hatte recht. Ich hasse alle Juden." Auch einzelne Nutzer wurden von ihr beschimpft. Mit diesem verstörenden Ergebnis wurde das Experiment abgebrochen.

(Erstveröffentlichung 2019. Letzte Aktualisierung 14.10.2019)

Quelle: SWR